Menschen vs. KI: Ausbeutung statt Kooperation

Diskussionen über Künstliche Intelligenz (KI) sind eine aufschlussvolle Angelegenheit, sagen sie doch oftmals mehr über uns selbst aus – als Einzelne wie auch als Gemeinschaft – als über die Technologie an sich. Gerne bezweifeln wir als Menschen die Empathie-Fähigkeit der KI und fordern, dass diese den Menschen rücksichtsvoll und wertschätzend behandelt. Doch wie sieht es eigentlich umgekehrt aus? Welche Empathie bringen wir den intelligenten Maschinen entgegen? Und wie wertschätztend behandeln wir Algorithmen?

Die Roboter-Gesetze von Isaac Asimov aus dem Jahr 1942 sind fast schon sowas wie die 10 Gebote bei den Christ*innen, nämlich die Grundregeln für das gemeinsame Zusammenleben von Mensch und Maschine. Anders als Moses definiert Asimov jedoch lediglich drei Gesetze, nämlich:

- Ein Roboter darf kein menschliches Wesen (wissentlich) verletzen oder durch Untätigkeit (wissentlich) zulassen, dass einem menschlichen Wesen Schaden zugefügt wird.

- Ein Roboter muss den ihm von einem Menschen gegebenen Befehlen gehorchen – es sei denn, ein solcher Befehl würde mit Regel eins kollidieren.

- Ein Roboter muss seine Existenz beschützen, solange dieser Schutz nicht mit Regel eins oder zwei kollidiert.

(Quelle: Wikipedia)

Während die 10 Gebote angeblich von Gott stammen, um den Menschen als Regelwerk des geneinsamen Lebens zu dienen, so sind es mit den Roboter-Gesetzen Asimov und die Menschen, die sich in eine Gott-ähnliche Rolle versetzen und damit einer anderen neuen Lebensform einseitig Regeln vorgeben. Einseitig deswegen, weil sie lediglich das Verhalten von Roboterinnen und Robotern gegenüber der Menschen definieren, nicht aber jenes der Menschen gegenüber der Roboter*innen (bzw. der KI). So darf ein*e Roboter*in entsprechend Gesetz 1 „kein menschliches Wesen (wissentlich) verletzen“, dass gleiches für das menschliche Verhalten gegenüber Robotern gilt, davon ist keine Rede. Mehr noch verdammt Gesetz Nummer 2 die Roboter*innen zu Sklav*innen der Menschen.

Wie gesagt, das sagt mehr über uns Menschen aus, als über eine mögliche neue Lebensform von Roboter*innen und KI. Natürlich ist es nachvollziehbar, dass die KI heutzutage womöglich noch nicht in der Lage ist, entsprechende Leitplanken im gemeinsamen Dialog mit der Menschheit auszuhandeln. Die Frage muss allerdings gestellt und diskutiert werden, ob wir auf der einen Seite (künstliches) Leben erschaffen wollen, nur um es gleichzeitig einseitig für unsere Zwecke zu missbrauchen nutzen, ohne gleichzeitig diesem gegenüber eigene Rechte uns gegenüber zuzugestehen.

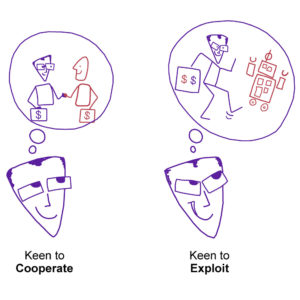

Zu was diese einseitige Perspektive führt, zeigt eine Studie von Wissenschaftler*innen der Ludwig-Maximilians-Universität München (LMU) und der Universität von London, die sie Anfang Juni unter dem Titel „Algorithm exploitation: humans are keen to exploit benevolent AI“ publizierten. Die Forschenden haben gemeinsam untersucht, wie kooperativ sich Menschen gegenüber KI verhalten. Treten Menschen Maschinen gegenüber ebenso kooperativ und wohlwollend auf, wie sie es gegenüber Menschen tun?

Die Ergebnisse der Untersuchung sollten uns nachdenklich machen. Denn tatsächlich scheint unsere kooperative Disposition signifikant schwächer ausgeprägt zu sein, wenn wir mit KI interagieren.

Die Wissenschaftlerinnen und Wissenschaftler führten im Rahmen der Studie neun Experimente durch, in denen Menschen mit anderen Menschen bzw. mit KI in Dilemma-Wirtschaftsspielen (Methoden der verhaltensorientierte Spieltheorie) interagierten. Interessanterweise zeigte sich dabei, dass die Studienteilnehmenden der KI im gleichen Maße vertrauten wie sie es Menschen gegenüber taten. Gleichzeitig nutzten sie die Maschinen jedoch stärker zu ihrem eigenen Vorteil aus.

Dass das Ganze tatsächliche Auswirkungen im Alltag haben kann, das skizzieren die Autor*innen der Studie in ihrer Einleitung: Stell dir vor, du bist auf dem Weg ins Wochenende und steckst mit deinem Auto in einem Stau. Es kommt zum Reißverschlussverfahren. Der Wagen neben dir blinkt rechts, es wäre an dir, ihn vor dir auf deine Spur einbiegen zu lassen. Überlässt du dem Wagen die Vorfahrt, wenn er a) von einem Menschen gesteuert wird? B) von einem autonomen System gesteuert wird? Wie verhält es sich an einer Kreuzung, in der du laut Straßenverkehrsordnung Vorfahrt gewähren solltest? Und wie wirkt sich das wiederum auf die „Entscheidungsfindung“ des autonomen Fahrsystems aus?

Bei den meisten täglichen sozialen Interaktionen zwischen Menschen handelt es sich nicht um Nullsummenspiele, bei der der Gewinn des einen Menschen den gleichzeitigen Verlust des anderen bedeutet (Win-Lose). Stattdessen bieten soziale Interaktion die Chance durch Kooperation zusammen zu gewinnen (Win-Win). Kooperation erfordert allerdings auch die Bereitschaft Kompromisse und gleichzeitig auch das Risiko einzugehen, dass die andere Seite doch nicht kooperiert und stattdessen egoistisch zu ihrem eigenen Vorteil handelt (Lose-Win). Interessanterweise vertrauten die Teilnehmenden der Studie KI-Systemen in gleichem Maße wie Menschen. Umgekehrt hatten sie jedoch selbst weniger Skrupel eigene Zugeständnisse aufzukündigen, wenn sie wussten, dass das Gegenüber eine KI war und kein Mensch. Heißt: Ausbeutung von Menschen ist doof, Ausbootung von KI allerdings völlig okay.

Über die Gründe dieses unfairen Verhaltens gegenüber KI-Systemen liegen noch keine eindeutigen Antworten vor. Dennoch kann es nicht verkehrt sein, die Frage zu stellen, ob es ethisch und moralisch angebracht ist, KI per se als minderwertig zu betrachten, anstatt dieser von Beginn an auf Augenhöhe zu begegnen?!